LLaMA Factory微调合并Qwen2-vl模型简单流程(阿里云云平台上操作)2

没什么可以总结的,大部分为文档上的内容LoRA 合并 - LLaMA Factory这几个阿里云的项目是一个系列,全过程记录了在阿里云服务器上进行千问模型的部署微调合并量化调用使用等。开源从你我开始。

·

前期准备

1.llamafactory下载完成,sft微调完成

2.再llamafactory文件下创建一个models文件夹,qwen_lora_sft.yaml文件

3.进入llamafactroy文件夹

流程

qwen_lora_sft.yaml文件内容

### Note: DO NOT use quantized model or quantization_bit when merging lora adapters

### model

model_name_or_path: /mnt/workspace/Qwen2-VL-2B-Instruct

adapter_name_or_path: /mnt/workspace/LLaMA-Factory/saves/Qwen2-VL-2B-Instruct/lora/train_2025-01-19-16-13-00

template: qwen2_vl

finetuning_type: lora

trust_remote_code: true

### export

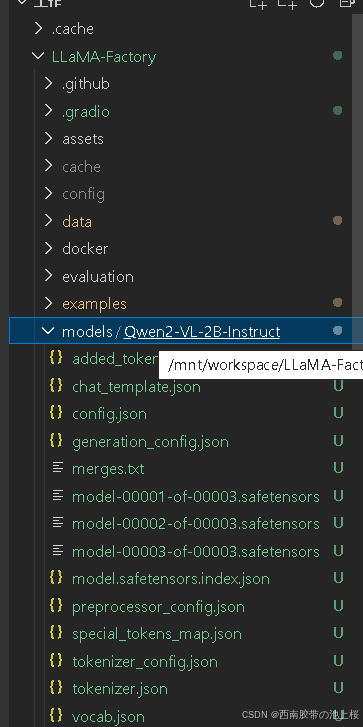

export_dir: /mnt/workspace/LLaMA-Factory/models/Qwen2-VL-2B-Instruct

export_size: 2

export_device: cpu

export_legacy_format: false终端运行

llamafactory-cli export qwen_lora_sft.yaml结果

后面就可以调用他作为api接口了。

总结

没什么可以总结的,大部分为文档上的内容

这几个阿里云的项目是一个系列,全过程记录了在阿里云服务器上进行千问模型的部署微调合并量化调用使用等。

开源从你我开始

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)