大模型算法岗面试题系列(三十四)| 多轮对话任务如何微调模型?

多轮对话任务的微调需要特别关注对话的上下文理解、连贯性以及个性化回应的能力。通过这些步骤,可以有效地对模型进行微调,以适应多轮对话任务的需求,提高对话的自然性、相关性和用户满意度。

面试题:多轮对话任务如何微调模型?

参考答案

多轮对话任务的微调需要特别关注对话的上下文理解、连贯性以及个性化回应的能力。以下是微调模型进行多轮对话任务的具体步骤:

- 数据准备:

- 收集多轮对话数据,这些数据应该包含真实的对话场景,涵盖不同的主题和领域。

- 确保数据具有多样性,包括不同的说话者、风格和对话长度。

- 预处理:

- 对对话数据进行清洗和格式化,以适应模型的输入要求。

- 可能需要将对话分割成上下文和回应对,以便于模型学习如何根据上下文生成回应。

- 上下文建模:

- 确保模型能够处理和记忆对话的上下文信息。这通常通过使用具有记忆能力的模型架构来实现,如基于Transformer的模型,它们可以利用自注意力机制来捕捉长距离依赖关系。

- 个性化和一致性:

- 在微调过程中,训练模型以生成符合对话上下文和用户个性的回应。

- 使用技术如个性化嵌入或条件生成模型来保持对话的一致性和连贯性。

- 损失函数设计:

- 选择合适的损失函数来优化模型。对于对话任务,可能需要使用序列生成任务的损失函数,如交叉熵损失,同时考虑BLEU、ROUGE等评估指标。

- 微调策略:

- 在预训练模型的基础上进行微调。可以选择全参数微调,也可以选择只微调模型的某些部分,如顶层或输出层。

- 使用少量的领域特定数据进行微调,以避免过拟合。

- 迭代优化:

- 在微调过程中,不断评估模型的对话质量,包括流畅性、相关性和准确性。

- 根据评估结果调整模型参数和训练策略。

通过这些步骤,可以有效地对模型进行微调,以适应多轮对话任务的需求,提高对话的自然性、相关性和用户满意度。

文末

有需要全套的AI大模型面试题及答案解析资料的小伙伴,可以微信扫描下方CSDN官方认证二维码,免费领取【

保证100%免费】

更多资料分享

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频,免费分享!

一、大模型全套的学习路线

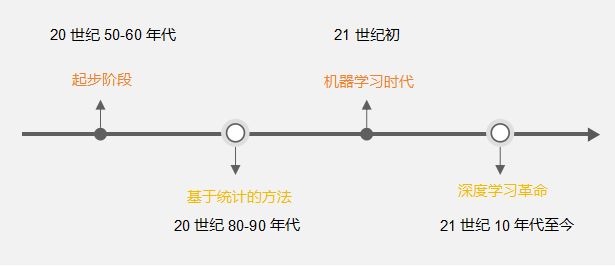

L1级别:AI大模型时代的华丽登场

L2级别:AI大模型API应用开发工程

L3级别:大模型应用架构进阶实践

L4级别:大模型微调与私有化部署

达到L4级别也就意味着你具备了在大多数技术岗位上胜任的能力,想要达到顶尖水平,可能还需要更多的专业技能和实战经验。

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、大模型经典PDF书籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

有需要全套的AI大模型学习资源的小伙伴,可以微信扫描下方CSDN官方认证二维码,免费领取【保证100%免费】

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)